تفاصيل النزاع بين البنتاغون وAnthropic:

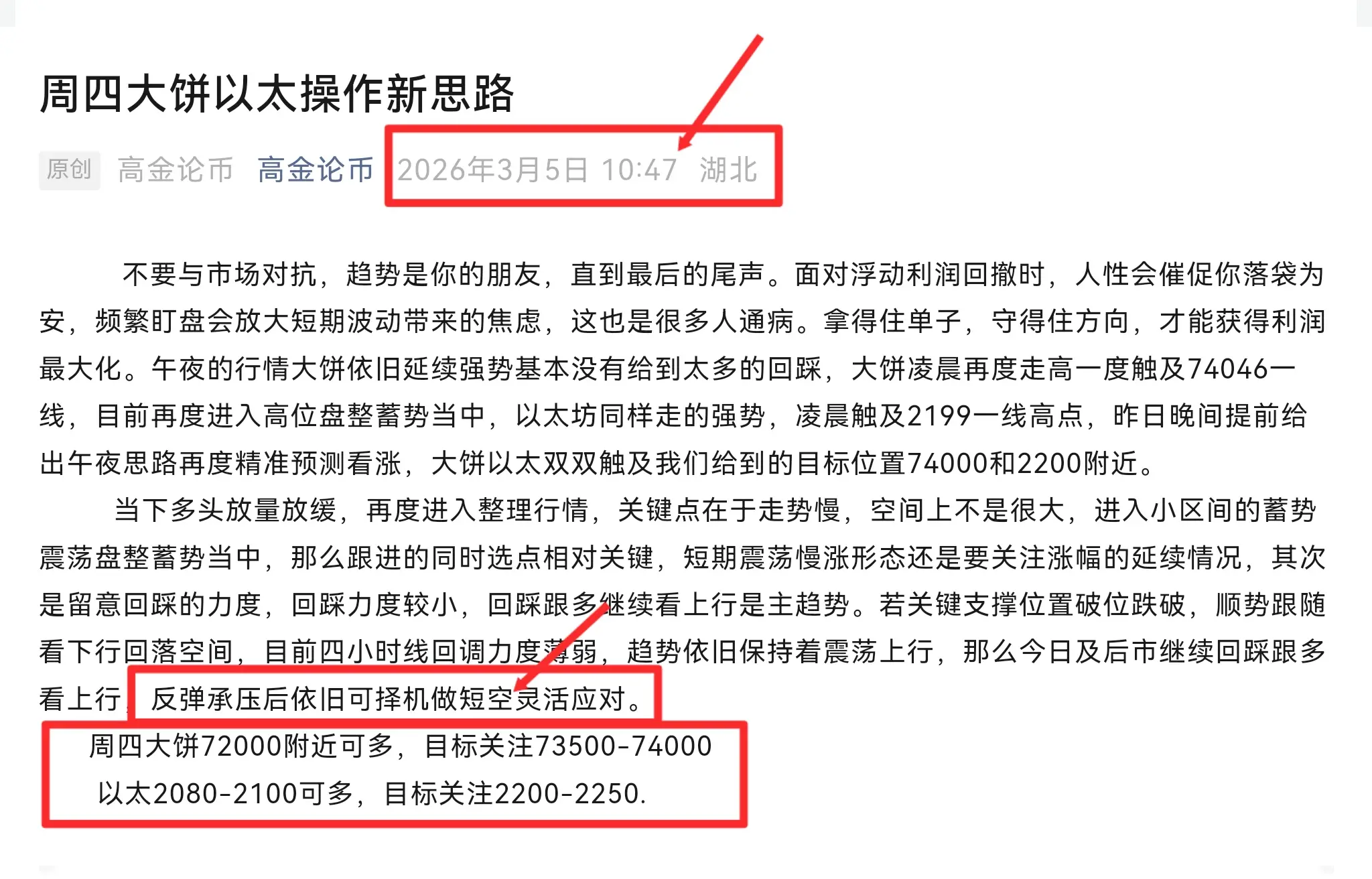

ينبع النزاع من عقد بقيمة تقريبية $200 مليون وقعته شركة Anthropic لاستخدام نموذج Claude AI الخاص بها في أنظمة سرية للقوات المسلحة الأمريكية.

حددّت Anthropic خطين أحمرين رئيسيين:

- عدم استخدام الذكاء الاصطناعي للمراقبة الجماعية للمواطنين الأمريكيين.

- عدم استخدامه في **أنظمة أسلحة ذاتية التشغيل بالكامل** (أسلحة تتخذ قرارات قاتلة بدون إشراف بشري)

ومع ذلك، طالب البنتاغون باستخدام غير محدود للذكاء الاصطناعي "لجميع الأغراض المشروعة" ولم يقبل بهذه القيود. واضطر وزير الدفاع بيت هيجسث إلى إجبار الشركة على الامتثال بحلول مساء الجمعة (26 فبراير 2026).

عندما لم يتم التوصل إلى اتفاق:

- أمر الرئيس ترامب جميع الوكالات الفيدرالية بـ **وقف فوري** لتقنية Anthropic (مع منح البنتاغون فترة انتقالية مدتها 6 أشهر).

- أعلن هيجسث أن Anthropic تعتبر "مخاطر في سلسلة التوريد على الأمن القومي" — وهو إجراء عقابي يُستخدم عادة ضد التهديدات الأجنبية؛ كما يمنع المقاولين العسكريين من التعامل مع الشركة.

وصفّت Anthropic القرار بأنه "غير قانوني ويؤسس سابقة" وأعلنت أنها ستتخذ الأمر إلى المحكمة. وأكد المدير التنفيذي داريو أموداي أنه لن يتراجع عن موقفه.

وفي النهاية، وقع البنتاغون اتفاقية جديدة مع OpenAI مع قبول قيود مماثلة. ويمثل هذا الحدث نقطة تحول رئيسية بشأن من يجب أن يحدد حدود الاستخدام العسكري للذكاء الاصطناعي — الشركات أم الحكومة؟

باختصار: ما بدأ كمناقشة حول مخاوف أمنية تصاعد إلى ضغط سياسي وعقوبات. لا تزال الصراعات بين أخلاقيات الذكاء الاصطناعي والأمن القومي مستمرة.

#TrumpordersfederalbanonAnthropicAI

ينبع النزاع من عقد بقيمة تقريبية $200 مليون وقعته شركة Anthropic لاستخدام نموذج Claude AI الخاص بها في أنظمة سرية للقوات المسلحة الأمريكية.

حددّت Anthropic خطين أحمرين رئيسيين:

- عدم استخدام الذكاء الاصطناعي للمراقبة الجماعية للمواطنين الأمريكيين.

- عدم استخدامه في **أنظمة أسلحة ذاتية التشغيل بالكامل** (أسلحة تتخذ قرارات قاتلة بدون إشراف بشري)

ومع ذلك، طالب البنتاغون باستخدام غير محدود للذكاء الاصطناعي "لجميع الأغراض المشروعة" ولم يقبل بهذه القيود. واضطر وزير الدفاع بيت هيجسث إلى إجبار الشركة على الامتثال بحلول مساء الجمعة (26 فبراير 2026).

عندما لم يتم التوصل إلى اتفاق:

- أمر الرئيس ترامب جميع الوكالات الفيدرالية بـ **وقف فوري** لتقنية Anthropic (مع منح البنتاغون فترة انتقالية مدتها 6 أشهر).

- أعلن هيجسث أن Anthropic تعتبر "مخاطر في سلسلة التوريد على الأمن القومي" — وهو إجراء عقابي يُستخدم عادة ضد التهديدات الأجنبية؛ كما يمنع المقاولين العسكريين من التعامل مع الشركة.

وصفّت Anthropic القرار بأنه "غير قانوني ويؤسس سابقة" وأعلنت أنها ستتخذ الأمر إلى المحكمة. وأكد المدير التنفيذي داريو أموداي أنه لن يتراجع عن موقفه.

وفي النهاية، وقع البنتاغون اتفاقية جديدة مع OpenAI مع قبول قيود مماثلة. ويمثل هذا الحدث نقطة تحول رئيسية بشأن من يجب أن يحدد حدود الاستخدام العسكري للذكاء الاصطناعي — الشركات أم الحكومة؟

باختصار: ما بدأ كمناقشة حول مخاوف أمنية تصاعد إلى ضغط سياسي وعقوبات. لا تزال الصراعات بين أخلاقيات الذكاء الاصطناعي والأمن القومي مستمرة.

#TrumpordersfederalbanonAnthropicAI