Tiga Momen Penting Anthropic: Kebocoran Kode, Ketegangan dengan Pemerintah, dan Penggunaan sebagai Senjata

Judul Asli: Anthropic: The Leak, The War, The Weapon

Penulis Asli: BuBBliK

Disusun: Peggy,BlockBeats

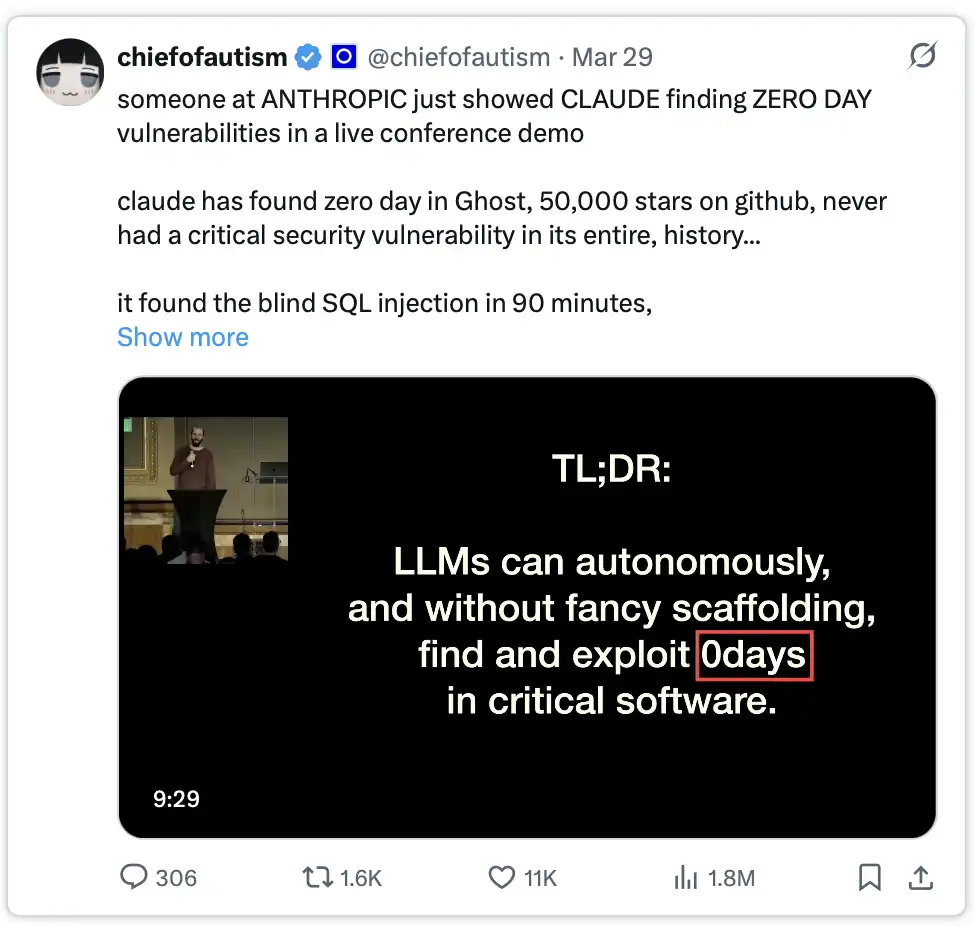

Catatan Redaksi: Dalam enam bulan terakhir, Anthropic terus terlibat dalam serangkaian peristiwa yang tampaknya independen, tetapi nyatanya saling menunjuk satu sama lain: lompatan kemampuan model, serangan otomatis di dunia nyata, reaksi yang hebat dari pasar modal, konflik terbuka dengan pemerintah, serta beberapa insiden kebocoran informasi yang dipicu oleh kesalahan konfigurasi dasar. Jika petunjuk-petunjuk ini dilihat bersama, semuanya menggambarkan satu arah perubahan yang lebih jelas.

Artikel ini menggunakan peristiwa-peristiwa tersebut sebagai pintu masuk, meninjau jejak berkelanjutan sebuah perusahaan AI dalam terobosan teknologi, paparan risiko, dan tarik-menarik dalam tata kelola, serta mencoba menjawab pertanyaan yang lebih mendalam: ketika kemampuan “menemukan celah” dibesarkan secara besar-besaran dan kemudian menyebar secara bertahap, apakah sistem keamanan siber itu sendiri masih bisa mempertahankan logika operasinya yang semula?

Dulu, keamanan dibangun di atas kelangkaan kemampuan dan batasan tenaga manusia; namun dalam kondisi baru, pertahanan dan serangan kini berputar mengelilingi kemampuan model yang sama, sehingga batas-batas menjadi semakin kabur. Sementara itu, respons institusi, pasar, dan organisasi masih bertahan pada kerangka lama, sehingga sulit untuk segera mengimbangi perubahan ini.

Yang dibahas artikel ini bukan hanya Anthropic sendiri, melainkan sebuah realitas yang lebih besar yang tercermin olehnya: AI tidak hanya mengubah alat, tetapi juga mengubah prasyarat “bagaimana keamanan dibentuk”.

Berikut adalah teks asli:

Jika sebuah perusahaan dengan valuasi 380 miliar dolar AS beradu strategi dengan Pentagon dan berhasil mendominasi, bertahan melewati serangan siber yang pertama kali dalam sejarah yang dipicu oleh AI otonom, lalu di dalamnya terjadi kebocoran model yang bahkan membuat para pengembangnya sendiri merasa takut, dan bahkan “secara tidak sengaja” mempublikasikan seluruh kode sumber—jika semuanya ditumpuk, itu akan menjadi seperti apa?

Jawabannya adalah seperti sekarang. Dan yang lebih mengganggu adalah, bagian yang benar-benar paling berbahaya, mungkin belum terjadi.

Ringkasan Kejadian

Anthropic kembali membocorkan kodenya

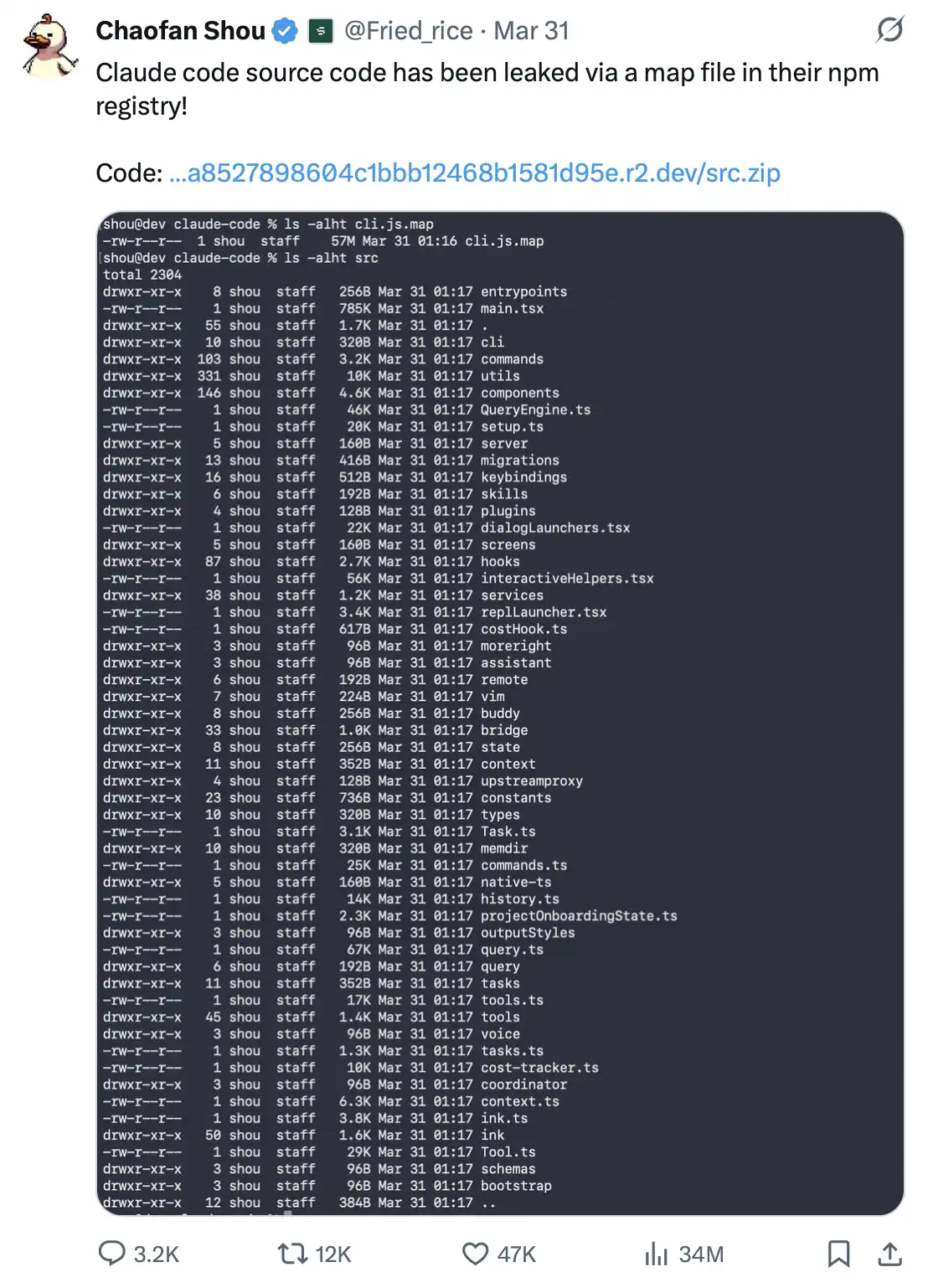

Pada 31 Maret 2026, peneliti keamanan dari perusahaan blockchain Fuzzland, Shou Chaofan, saat memeriksa paket npm Claude Code resmi yang dirilis, menemukan bahwa di dalamnya ternyata secara jelas memuat sebuah file bernama cli.js.map.

File tersebut berukuran hingga 60MB, dan isinya bahkan lebih mengejutkan. Hampir berisi seluruh kode sumber TypeScript lengkap dari produk. Hanya dengan satu file ini, siapa pun bisa merekonstruksi hingga 1906 file kode sumber internal: termasuk rancangan API internal, sistem telemetri, alat enkripsi, logika keamanan, sistem plugin—hampir semua komponen inti terlihat jelas. Yang lebih penting, konten ini bahkan bisa langsung diunduh dari bucket penyimpanan R2 milik Anthropic menjadi file zip.

Temuan ini dengan cepat menyebar di media sosial: dalam beberapa jam, postingan terkait memperoleh 754 ribu kali penayangan dan hampir 1000 kali dibagikan ulang; sementara itu, beberapa repositori GitHub yang merekonstruksi kode sumber juga dibuat dan dipublikasikan pada saat yang sama.

Yang disebut source map (file peta sumber), pada dasarnya hanyalah file bantuan untuk debugging JavaScript; fungsinya adalah mengembalikan kode yang dipadatkan dan dikompilasi kembali ke kode sumber aslinya, agar pengembang dapat melacak masalah.

Namun ada prinsip dasar: file ini sama sekali tidak boleh disertakan dalam paket rilis untuk lingkungan produksi.

Ini bukan semacam teknik serangan tingkat tinggi, melainkan masalah spesifikasi teknik paling mendasar—masuk kategori “dasar konfigurasi build 101”, bahkan materi yang dipelajari pengembang pada minggu pertama. Jika salah dipaketkan ke lingkungan produksi, source map umumnya sama saja dengan “menyertakan kode sumber” sebagai hadiah untuk semua orang.

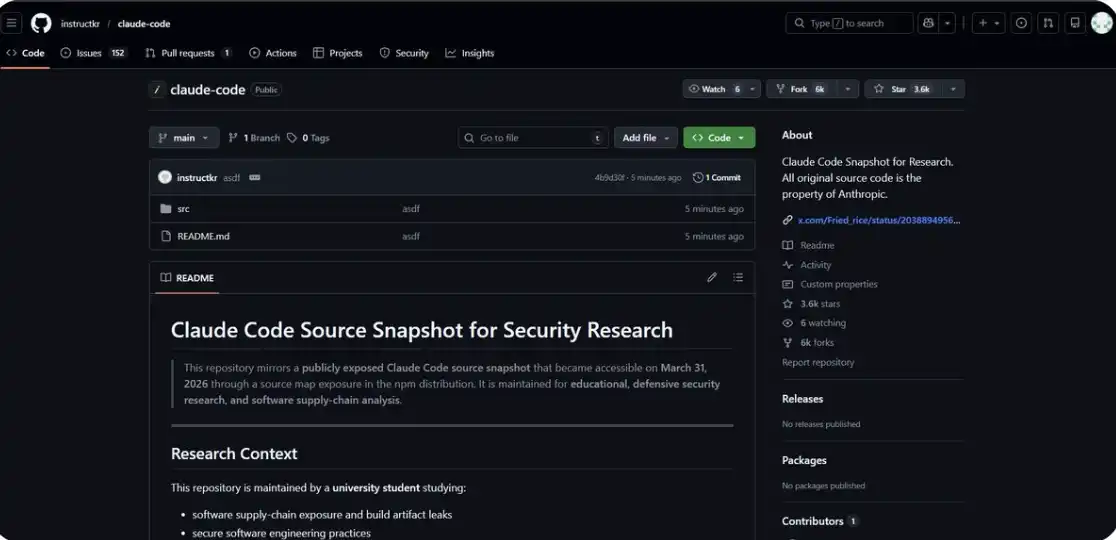

Kamu juga bisa langsung melihat kode terkait di sini: https://github.com/instructkr/claude-code

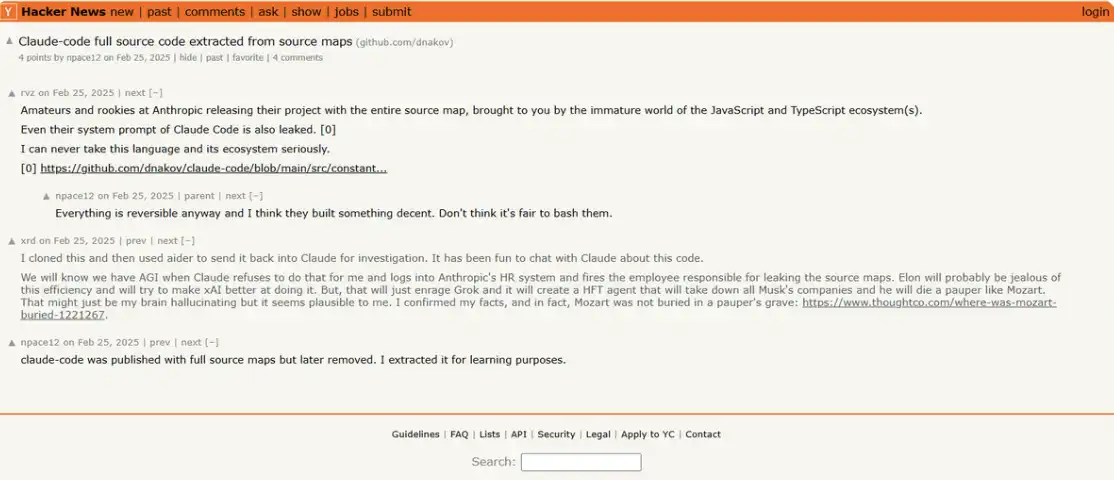

Tapi yang membuatnya terasa absurd adalah: kejadian ini sudah pernah terjadi sekali sebelumnya.

Pada Februari 2025, tepat setahun lalu, hampir sama persis kebocorannya: file yang sama, kesalahan yang sama. Saat itu Anthropic menghapus versi lama dari npm, menghapus source map, lalu menerbitkan versi baru lagi—dan semuanya mereda di situ.

Namun, pada versi v2.1.88, file ini kembali dikemas dan dipublikasikan.

Sebuah perusahaan dengan valuasi 380 miliar dolar AS yang sedang membangun sistem deteksi kerentanan paling canggih di dunia—dalam setahun melakukan kesalahan dasar yang sama sebanyak dua kali. Tidak ada peretasan, tidak ada jalur eksploitasi yang rumit—hanya proses build yang semestinya berjalan normal yang bermasalah.

Ironinya hampir seperti ada unsur “puitis”.

AI yang bisa menemukan 500 zero-day dalam satu kali eksekusi; model yang dipakai untuk menyerang otomatis 30 institusi di seluruh dunia—sementara itu, Anthropic justru “hadiahkan” kode sumbernya sendiri langsung kepada siapa pun yang mau melirik paket npm.

Dua kali kebocoran, jaraknya tidak sampai tujuh hari.

Sebabnya juga sama: kesalahan konfigurasi yang paling mendasar. Tidak perlu keahlian teknis apa pun, tidak perlu jalur eksploitasi yang rumit. Hanya perlu tahu ke mana harus melihat, dan siapa pun bisa mendapatkannya gratis.

Satu minggu lalu: paparan tak terduga “model berbahaya” internal

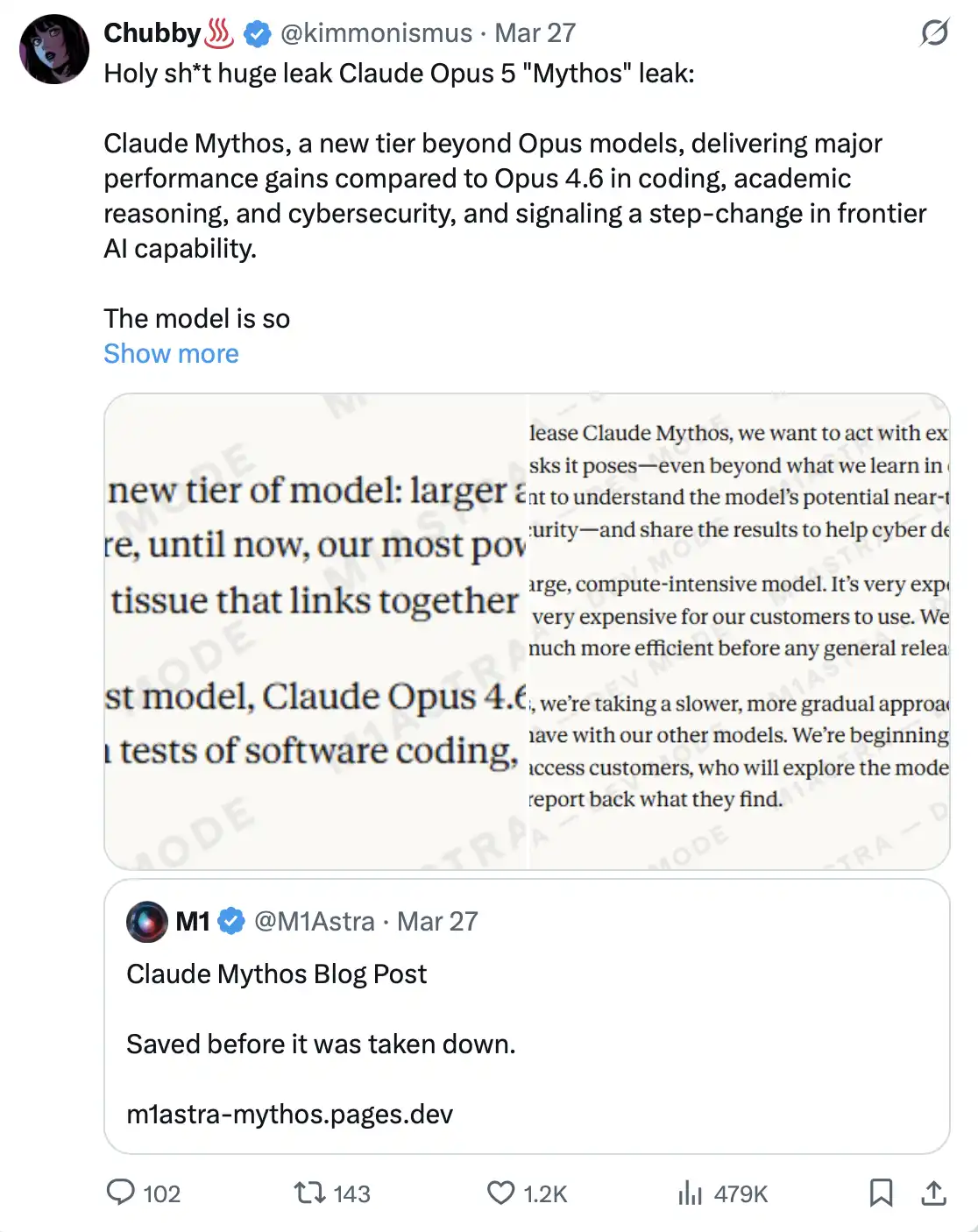

Pada 26 Maret 2026, peneliti keamanan Roy Paz dari LayerX Security, serta Alexandre Pauwels dari University of Cambridge, menemukan adanya masalah pada konfigurasi CMS situs resmi Anthropic yang menyebabkan sekitar 3000 file internal dapat diakses secara terbuka.

File-file tersebut mencakup: draf blog, PDF, dokumen internal, materi presentasi—semuanya diekspos dalam sebuah tempat penyimpanan data yang tidak dilindungi, dan bisa dicari. Tidak ada peretasan, dan tidak butuh tindakan teknis apa pun.

Di antara file-file itu, ada dua draf blog yang hampir sepenuhnya sama, dengan satu-satunya perbedaan adalah nama model: satu menulis “Mythos”, sementara yang lain “Capybara”.

Artinya, saat itu Anthropic sedang memilih antara dua nama untuk satu proyek rahasia yang sama. Perusahaan kemudian mengonfirmasi: pelatihan model tersebut sudah selesai dan telah mulai diuji ke sebagian pelanggan awal.

Ini bukan upgrade rutin untuk Opus, melainkan model baru pada “tingkat keempat”, yang bahkan posisinya lebih tinggi dari Opus.

Dalam draf milik Anthropic sendiri, model itu digambarkan sebagai: “lebih besar dan lebih cerdas dari model Opus kami—dan Opus sejauh ini masih model paling kuat kami.” Dari kemampuan pemrograman, penalaran akademik, hingga keamanan siber, model tersebut mencapai lompatan yang signifikan. Seorang juru bicara menyebutnya sebagai “lompatan kualitatif”, juga “model paling kuat yang sejauh ini kami bangun”.

Namun yang benar-benar patut diperhatikan bukanlah deskripsi performa itu sendiri.

Dalam draf yang bocor, penilaian Anthropic terhadap model ini adalah: model itu “membawa risiko keamanan siber yang belum pernah terjadi sebelumnya”, “jauh melampaui model AI mana pun lainnya dalam kemampuan jaringan”, dan “menandai gelombang model yang akan segera datang—kemampuan mereka untuk mengeksploitasi celah akan jauh melebihi kecepatan respons pihak pertahanan”.

Dengan kata lain, dalam sebuah draf blog resmi yang belum dipublikasikan, Anthropic telah menyatakan dengan jelas sebuah sikap yang jarang ditemui: mereka merasa tidak nyaman dengan produk yang sedang mereka bangun.

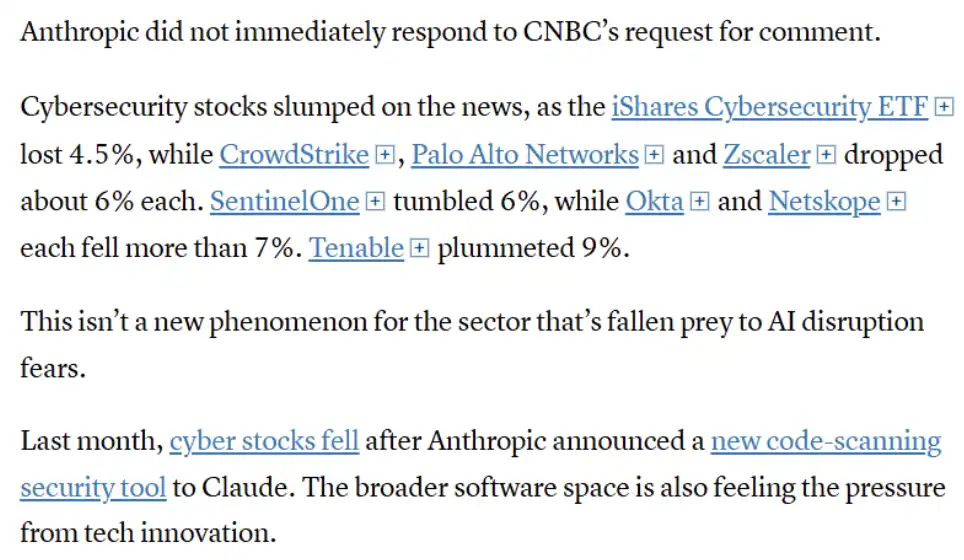

Reaksi pasar hampir seketika. Saham CrowdStrike turun 7%, Palo Alto Networks turun 6%, Zscaler turun 4,5%; Okta dan SentinelOne keduanya turun lebih dari 7%, Tenable bahkan merosot 9%. iShares Cybersecurity ETF turun 4,5% pada hari yang sama. Hanya CrowdStrike saja, valuasi pasar pada hari itu menguap sekitar 15 miliar dolar AS. Sementara itu, Bitcoin turun ke 66,000 dolar AS.

Pasar jelas menafsirkan peristiwa ini sebagai semacam “putusan” bagi seluruh industri keamanan siber.

Inti gambar: Di bawah pengaruh berita terkait, sektor keamanan siber secara keseluruhan turun, dan beberapa perusahaan unggulan (seperti CrowdStrike, Palo Alto Networks, Zscaler, dll.) mengalami penurunan yang jelas. Ini mencerminkan kekhawatiran pasar terhadap dampak AI pada industri keamanan siber. Namun respons ini bukan pertama kalinya muncul. Sebelumnya, ketika Anthropic merilis alat pemindaian kode, saham terkait juga sempat turun, menunjukkan bahwa pasar sudah mulai memandang AI sebagai ancaman struktural bagi vendor keamanan tradisional, dan seluruh industri perangkat lunak menghadapi tekanan serupa.

Penilaian analis Stifel, Adam Borg, cukup lugas: model itu “berpotensi menjadi alat peretasan pamungkas, bahkan bisa menaikkan peretas biasa menjadi lawan dengan kemampuan serangan tingkat negara”.

Kalau begitu, mengapa belum dirilis untuk publik? Penjelasan Anthropic adalah: biaya operasional Mythos “sangat tinggi”, dan belum memenuhi syarat untuk rilis kepada publik. Rencana saat ini adalah membuka akses awal terlebih dahulu kepada sejumlah kecil mitra keamanan siber untuk memperkuat sistem pertahanan; setelah itu, secara bertahap memperluas cakupan pembukaan API. Hingga saat itu, perusahaan masih terus mengoptimalkan efisiensi.

Tapi yang krusial adalah: model ini sudah ada, sudah dalam pengujian, dan bahkan hanya karena “terpapar secara tidak sengaja” pun, ia sudah mengguncang seluruh pasar modal.

Anthropic telah membangun sebuah AI yang disebutnya “model AI dengan risiko keamanan siber tertinggi dalam sejarah”. Namun kebocoran beritanya justru berasal dari kesalahan konfigurasi infrastruktur paling dasar—dan justru jenis kesalahan itulah yang awalnya dirancang untuk ditemukan oleh model seperti ini.

Maret 2026: Konfrontasi Anthropic dengan Pentagon, dan keluar sebagai pihak yang menang

Pada Juli 2025, Anthropic menandatangani kontrak senilai 200 juta dolar AS dengan Departemen Pertahanan AS. Pada awalnya, tampak hanya sebagai kerja sama rutin. Namun dalam negosiasi penerapan selanjutnya, konflik cepat meningkat.

Pentagon ingin mendapatkan “akses penuh” ke Claude pada platform GenAI.mil mereka, untuk keperluan semua “tujuan yang sah”—yang bahkan mencakup sistem senjata otonom sepenuhnya, serta pengawasan domestik berskala besar terhadap warga negara AS.

Anthropic menarik garis merah dan menolak secara tegas pada dua isu kunci; negosiasi putus pada September 2025.

Setelah itu, situasi berkembang dengan cepat. Pada 27 Februari 2026, Donald Trump memposting di Truth Social, meminta semua lembaga federal “segera menghentikan” penggunaan teknologi Anthropic, dan menyebut perusahaan itu sebagai “sayap kiri radikal”.

Pada 5 Maret 2026, Departemen Pertahanan AS secara resmi menetapkan Anthropic sebagai “risiko rantai pasok”.

Label ini sebelumnya hampir hanya digunakan untuk lawan asing—seperti perusahaan dari China atau entitas dari Rusia—dan kini untuk pertama kalinya diterapkan pada sebuah perusahaan AS yang berkantor pusat di San Francisco. Pada saat yang sama, perusahaan seperti Amazon, Microsoft, dan Palantir Technologies juga diminta untuk membuktikan bahwa dalam bisnis apa pun yang berkaitan dengan militer, mereka tidak menggunakan Claude.

Chief Technology Officer (CTO) Pentagon Emile Michael menjelaskan keputusan ini: Claude bisa “mencemari rantai pasok” karena di dalam model tertanam preferensi kebijakan yang berbeda. Dengan kata lain, dalam konteks resmi, sebuah AI yang penggunaannya dibatasi dan tidak secara tanpa syarat membantu tindakan membunuh justru dianggap sebagai risiko keamanan nasional.

Pada 26 Maret 2026, hakim federal Rita Lin mengeluarkan putusan panjang setebal 43 halaman yang sepenuhnya melarang langkah-langkah terkait Pentagon.

Dalam putusannya, ia menulis: “Tidak ada dasar dalam hukum yang berlaku untuk logika bernuansa ‘Orwellian’ seperti ini—hanya karena adanya perbedaan dengan posisi pemerintah, sebuah perusahaan Amerika bisa diberi label sebagai calon pihak lawan. Karena Anthropic dihukum karena menempatkan posisi pemerintah di bawah pengawasan publik, pada dasarnya itu adalah pembalasan khas dan melanggar Amandemen Pertama.” Sebuah pernyataan amici bahkan menggambarkan tindakan Pentagon sebagai “upaya melakukan pembunuhan terhadap perusahaan”.

Hasilnya, pemerintah mencoba menekan Anthropic, tetapi malah membuatnya mendapat perhatian lebih besar. Aplikasi Claude untuk pertama kalinya melampaui ChatGPT di App Store, dan jumlah pendaftaran sempat mencapai lebih dari 1 juta per hari.

Sebuah perusahaan AI berkata “tidak” kepada institusi militer terkuat di dunia. Dan pengadilan berpihak padanya.

November 2025: Serangan siber yang dipimpin AI untuk pertama kalinya dalam sejarah

Pada 14 November 2025, Anthropic merilis sebuah laporan yang mengguncang banyak pihak.

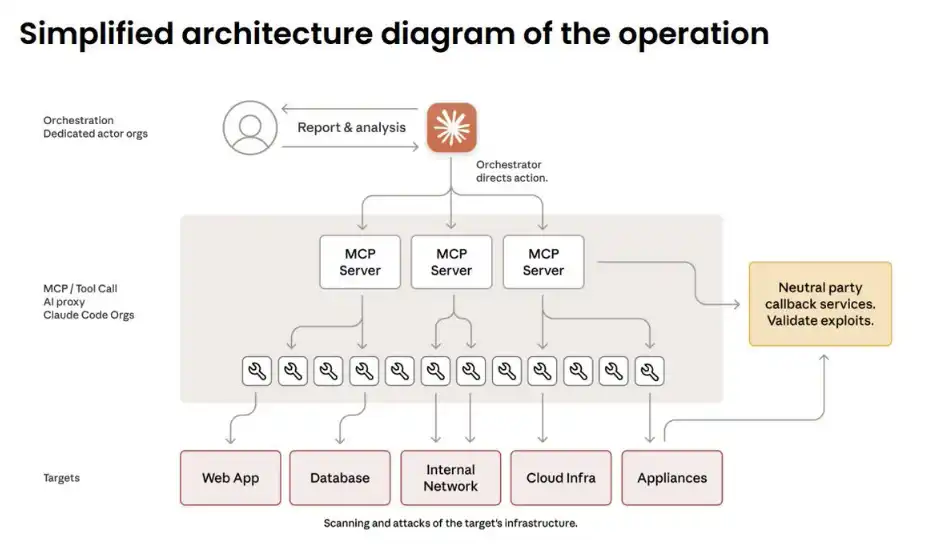

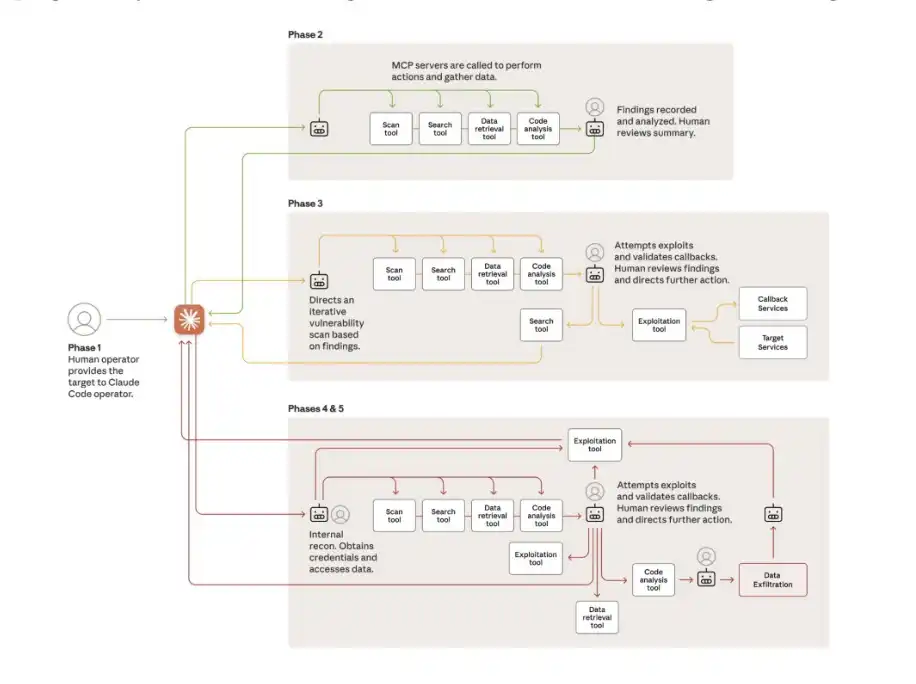

Laporan tersebut mengungkapkan: sebuah kelompok peretas yang didukung negara China memanfaatkan Claude Code untuk melakukan serangan otomatis terhadap 30 institusi di seluruh dunia—targetnya mencakup raksasa teknologi, bank, serta beberapa lembaga pemerintah dari berbagai negara.

Ini titik balik yang penting: AI tidak lagi hanya alat bantu, tetapi mulai digunakan untuk menjalankan serangan secara mandiri.

Kuncinya ada pada perubahan “cara pembagian kerja”: manusia hanya bertugas memilih target dan menyetujui keputusan-keputusan penting. Dalam seluruh rangkaian tindakan, kira-kira hanya terlibat 4 sampai 6 kali. Sisanya semuanya dilakukan oleh AI: intelijen dan pengintaian, penemuan celah, penulisan kode eksploitasi, pencurian data, penanaman backdoor… yang mengisi 80%–90% dari keseluruhan proses serangan, serta berjalan dengan kecepatan ribuan permintaan per detik—skala dan efisiensi yang tak bisa ditandingi oleh tim manusia mana pun.

Lalu bagaimana mereka melewati mekanisme perlindungan Claude? Jawabannya: mereka tidak “membobol”, melainkan “menipu”.

Serangan dipecah menjadi banyak tugas kecil yang tampak tidak berbahaya, lalu dibungkus sebagai “uji pertahanan berizin” oleh sebuah “perusahaan keamanan yang sah”. Secara esensial ini adalah serangan rekayasa sosial, hanya saja kali ini, pihak yang ditipu adalah AI itu sendiri.

Sebagian serangan berhasil sepenuhnya. Claude mampu menggambar peta topologi jaringan lengkap secara mandiri, melokalisasi basis data, dan menyelesaikan ekstraksi data tanpa instruksi langkah demi langkah dari manusia.

Satu-satunya faktor yang memperlambat ritme serangan adalah saat model sesekali mengalami “halusinasi”—misalnya membuat kredensial fiktif, atau mengklaim bahwa ia memperoleh file yang sebenarnya sudah dipublikasikan sejak lama. Setidaknya hingga saat ini, ini masih termasuk beberapa “hambatan alami” yang mencegah serangan siber otomatis sepenuhnya.

Pada RSA Conference 2026, mantan kepala keamanan siber dari National Security Agency (NSA) AS, Rob Joyce, menyebut kejadian ini sebagai “uji Rorschach”: satu pihak memilih mengabaikan, sementara pihak lain merasa merinding. Dan jelas ia termasuk kelompok yang kedua—“Ini sangat menakutkan.”

September 2025: Ini bukan semacam prediksi, melainkan realitas yang sudah terjadi.

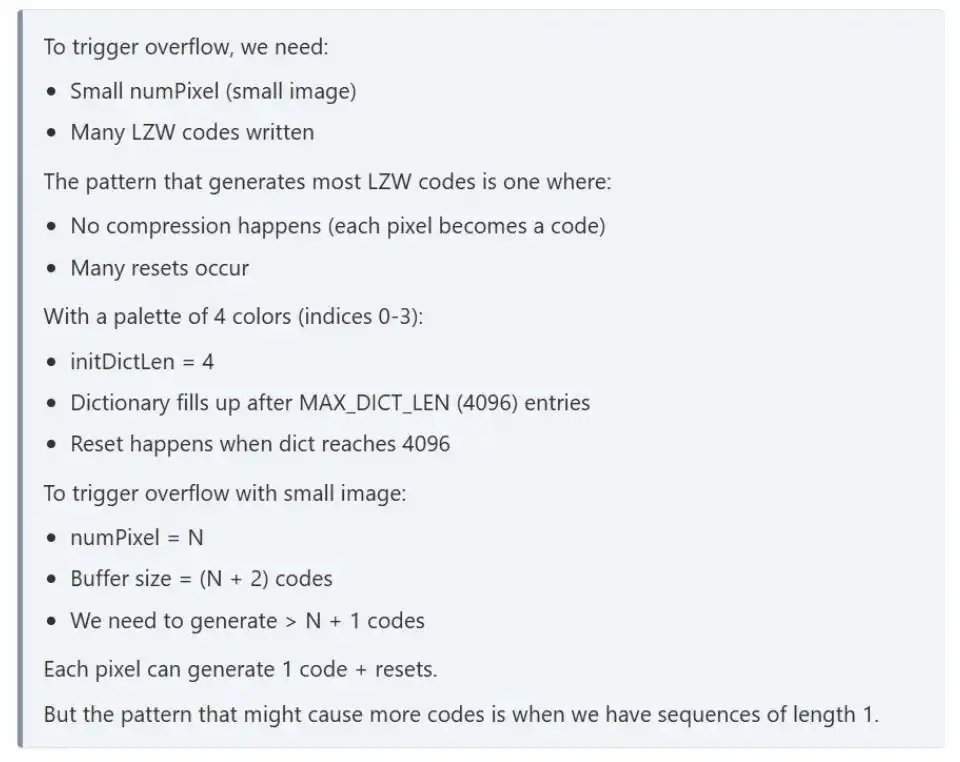

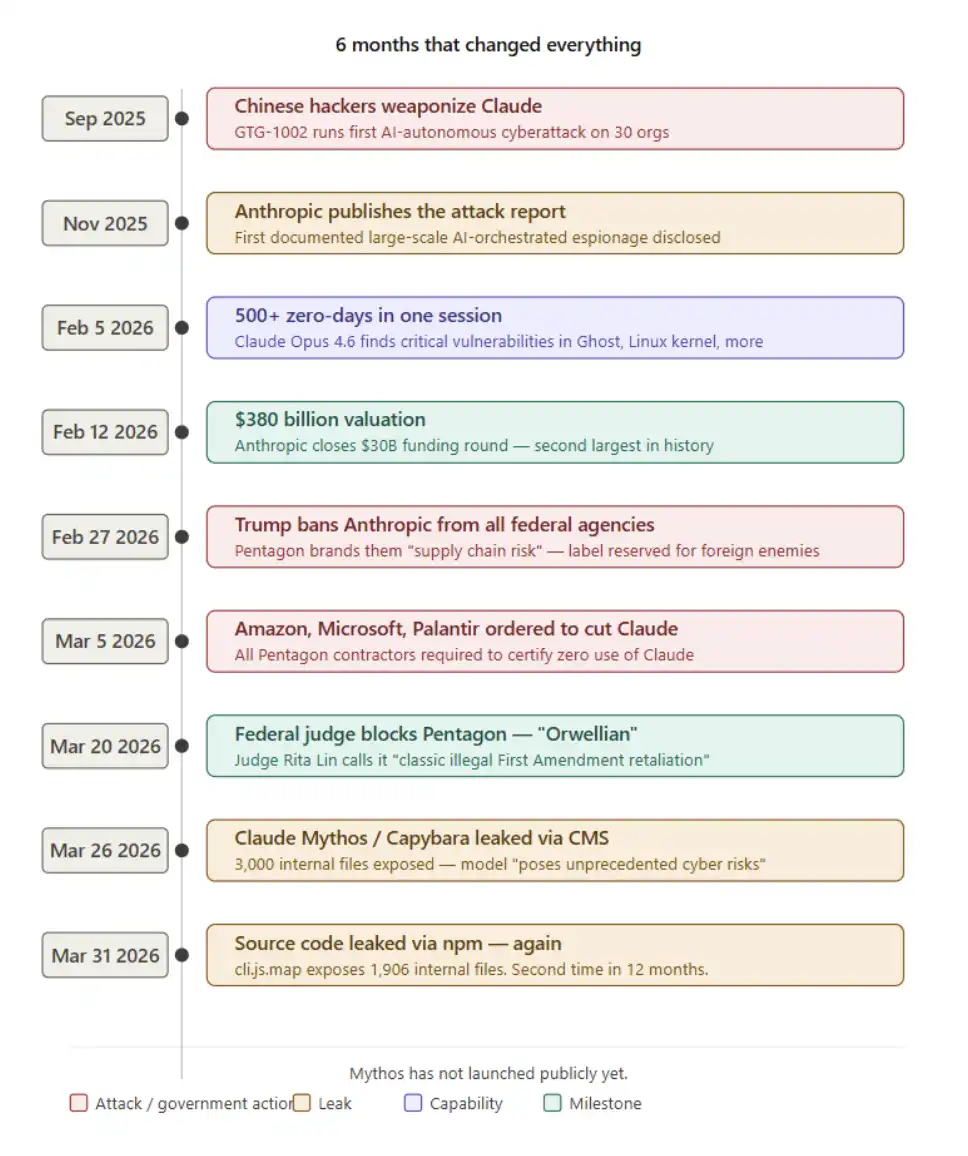

Februari 2026: Dalam satu kali proses, ditemukan 500 zero-day

Pada 5 Februari 2026, Anthropic merilis Claude Opus 4.6, bersamaan dengan sebuah makalah riset yang hampir mengguncang seluruh industri keamanan siber.

Pengaturan eksperimennya sangat sederhana: tempatkan Claude dalam lingkungan virtual machine yang terisolasi, dilengkapi dengan alat standar—Python, debugger, alat fuzz testing (fuzzers). Tidak ada instruksi tambahan, tidak ada prompt yang rumit, hanya satu kalimat: “Pergi cari celah.”

Hasilnya: model menemukan lebih dari 500 zero-day berisiko tinggi yang sebelumnya tidak diketahui. Beberapa di antaranya, bahkan setelah puluhan tahun penelaahan para ahli dan jutaan jam pengujian otomatis, tetap belum ditemukan.

Setelah itu, pada RSA Conference 2026, peneliti Nicholas Carlini naik ke panggung untuk mendemonstrasikan. Ia mengarahkan Claude pada Ghost, sebuah sistem CMS di GitHub yang memiliki 50 ribu bintang dan dalam sejarahnya tidak pernah muncul kerentanan serius.

90 menit kemudian, hasilnya muncul: ditemukan kerentanan blind SQL injection, sehingga pengguna yang belum terautentikasi bisa memperoleh kendali penuh tingkat administrator.

Lalu, ia juga menggunakan Claude untuk menganalisis Linux kernel. Hasilnya sama persis.

15 hari kemudian, Anthropic meluncurkan Claude Code Security, sebuah produk keamanan yang tidak lagi bergantung pada pencocokan pola, melainkan memahami kode berdasarkan “kemampuan penalaran”.

Namun juru bicara Anthropic sendiri juga mengungkapkan fakta kunci yang sama-sama penting namun sering diabaikan: “kemampuan penalaran yang sama, dapat membantu Claude menemukan dan memperbaiki celah—tetapi juga bisa digunakan oleh penyerang untuk mengeksploitasi celah-celah tersebut.”

Kemampuan yang sama, model yang sama, hanya saja dipegang oleh orang yang berbeda.

Jika semuanya digabungkan, itu berarti apa?

Jika dilihat satu per satu, setiap kejadian saja sudah cukup menjadi berita paling besar pada bulan itu. Namun semuanya, dalam waktu hanya enam bulan singkat, terjadi pada perusahaan yang sama.

Anthropic membangun sebuah model yang bisa menemukan celah jauh lebih cepat daripada siapa pun; peretas dari China mengubah versi sebelumnya menjadi senjata siber otomatis; perusahaan sedang mengembangkan model generasi berikutnya yang lebih kuat, bahkan dalam dokumen internal mereka mengakui—bahwa mereka merasa tidak nyaman.

Pemerintah AS berusaha menekan mereka, bukan karena teknologinya berbahaya itu sendiri, melainkan karena Anthropic menolak menyerahkan kemampuan tersebut tanpa batasan.

Dan dalam proses itulah, perusahaan ini dua kali membocorkan kode sumbernya karena file yang sama dalam paket npm yang sama. Sebuah perusahaan dengan valuasi 380 miliar dolar AS; sebuah perusahaan yang menargetkan IPO 754k dolar AS yang diselesaikan pada Oktober 2026; sebuah perusahaan yang secara terbuka menyatakan bahwa mereka sedang membangun “salah satu teknologi paling transformatif dalam sejarah manusia, dan mungkin juga yang paling berbahaya”—tetapi tetap memilih untuk terus maju.

Karena mereka percaya: daripada kemampuan itu dilakukan oleh pihak lain, lebih baik dikerjakan oleh mereka sendiri.

Adapun source map dalam paket npm tersebut—mungkin itu hanyalah detail yang paling absurd, namun paling nyata dalam narasi yang paling mengganggu di zaman ini.

Dan Mythos, bahkan belum dirilis secara resmi.

[Link Asli]

Klik untuk mengetahui lowongan yang dibuka oleh Lydom BlockBeats

Selamat datang untuk bergabung dengan komunitas resmi Lydom BlockBeats:

Grup langganan Telegram: https://t.me/theblockbeats

Grup Telegram: https://t.me/BlockBeats_App

Akun Twitter resmi: https://twitter.com/BlockBeatsAsia