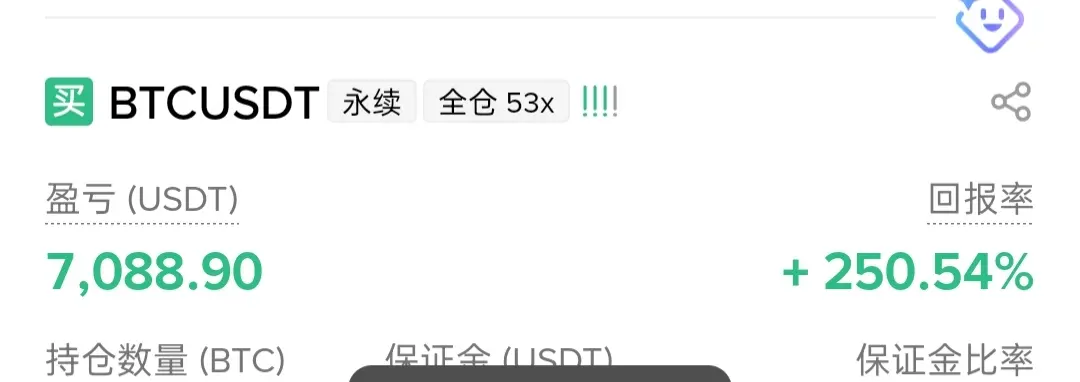

Фьючерсы

Доступ к сотням фьючерсов

TradFi

Золото

Одна платформа мировых активов

Опционы

Hot

Торги опционами Vanilla в европейском стиле

Единый счет

Увеличьте эффективность вашего капитала

Демо-торговля

Введение в торговлю фьючерсами

Подготовьтесь к торговле фьючерсами

Фьючерсные события

Получайте награды в событиях

Демо-торговля

Используйте виртуальные средства для торговли без риска

Запуск

CandyDrop

Собирайте конфеты, чтобы заработать аирдропы

Launchpool

Быстрый стейкинг, заработайте потенциальные новые токены

HODLer Airdrop

Удерживайте GT и получайте огромные аирдропы бесплатно

Pre-IPOs

Откройте полный доступ к глобальным IPO акций

Alpha Points

Торгуйте и получайте аирдропы

Фьючерсные баллы

Зарабатывайте баллы и получайте награды аирдропа

Инвестиции

Simple Earn

Зарабатывайте проценты с помощью неиспользуемых токенов

Автоинвест.

Автоинвестиции на регулярной основе.

Бивалютные инвестиции

Доход от волатильности рынка

Мягкий стейкинг

Получайте вознаграждения с помощью гибкого стейкинга

Криптозаймы

0 Fees

Заложите одну криптовалюту, чтобы занять другую

Центр кредитования

Единый центр кредитования