เหล่านักพัฒนาได้ทำให้ Claude พูดเหมือนมนุษย์ถ้ำเพื่อลดต้นทุน—และได้ผลจริง

โดยสรุป

- นักพัฒนาค้นพบว่าการบังคับให้ Claude พูดเหมือนมนุษย์ถ้ำจะทำให้จำนวนโทเคนเอาต์พุตลดลง และดังนั้นก็ทำให้ต้นทุนลดลงได้สูงสุดถึง 75%

- อินเทอร์เน็ตนำเรื่องนี้ไปทำเป็นทักษะบน GitHub ทันที

- เมื่อ Anthropic คิดค่าบริการสูงมากต่อโทเคนเอาต์พุต grunt-mode จึงไม่ใช่เรื่องตลกอีกต่อไป แต่กลายเป็นกลยุทธ์ด้านงบประมาณ

ระหว่างการออกแบบพรอมป์และศิลปะการแสดงเชิงประสิทธิภาพ นักพัฒนาคนหนึ่งได้โพสต์การค้นพบบน Reddit ซึ่งทำให้ชุมชน AI หัวเราะก่อนจะให้ความสนใจ: สอนให้ Claude สื่อสารเหมือนมนุษย์ยุคก่อนประวัติศาสตร์ แล้วดูบิลโทเคนเอาต์พุตของคุณหดลงได้สูงสุด 75% โพสต์ดังกล่าวเข้าถึง r/ClaudeAI เมื่อสัปดาห์ที่แล้ว และนับแต่นั้นมาก็มีความคิดเห็นมากกว่า 400 รายการและมีคะแนนโหวตกว่า 10K—เป็นการผสมผสานที่หายากระหว่างความเข้าใจเชิงเทคนิคที่แท้จริงและคอเมดี้แบบไร้สาระ ซึ่งอินเทอร์เน็ตมักจะให้รางวัล

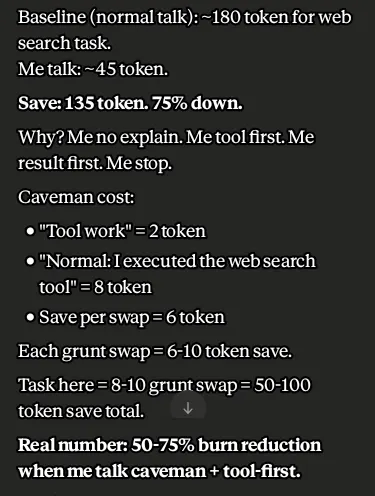

กลไกนั้นเรียบง่าย แทนที่จะปล่อยให้ Claude อุ่นเครื่องด้วยคำทักทายที่เป็นมิตร ให้เล่า “ทุกขั้นตอน” ที่มันทำ และปิดท้ายด้วยข้อเสนอเพื่อช่วยเพิ่มเติม นักพัฒนาจึงทำให้โมเดลถูกจำกัดให้เป็นประโยคสั้นๆ ที่ตัดทอนออก Tool first, result first, no explanation งานค้นหาข้อมูลบนเว็บแบบปกติที่โดยมากจะใช้ราว 180 โทเคนเอาต์พุต ลดลงเหลือประมาณ 45 ผู้โพสต์ต้นฉบับอ้างว่าลดเอาต์พุตได้สูงสุด 75% โดยทำให้โมเดลฟังเหมือนเพิ่ง “ค้นพบไฟ” ได้

ในภาษามนุษย์ถ้ำ ตามที่ผู้ใช้ Reddit คนหนึ่งกล่าวว่า: "Why waste time say lot word when few word do trick?” สิ่งที่เทคนิคนี้ไม่ได้แตะคือบริบทอินพุต: ประวัติการสนทนาทั้งหมด ไฟล์ที่แนบ และคำสั่งระบบที่โมเดลอ่านซ้ำทุกครั้งที่มีเทิร์นใหม่ โดยทั่วไปแล้วอินพุตนี้มักจะมีขนาดใหญ่กว่าเอาต์พุต โดยเฉพาะในเซสชันการโค้ดยาวๆ เซสชันในโลกจริงที่นับรวมอินพุตทั้งหมดนี้ คำนวณแล้วได้ส่วนลดราว 25% ไม่ใช่ 75% อย่างไรก็ตามยังถือว่ามีความหมาย แต่อยู่ไม่ถึงตัวเลขพาดหัว นอกจากนี้ยังเป็นความคิดที่ดีที่จะป้อนโมเดลด้วยคำสั่งแบบปกติ อย่าให้มันคุยแบบ “มนุษย์ถ้ำ” เพราะมันอาจไหลลงไปสู่สถานการณ์ “garbage in, garbage out”

ยังมีคำถามเรื่องการเสื่อมคุณภาพของสติปัญญาด้วย นักวิจัยบางส่วนในเธรดโต้แย้งว่าการบังคับให้ AI ไปอยู่ในบุคลิกที่ไม่ซับซ้อนอาจทำให้คุณภาพการใช้เหตุผลแย่ลงอย่างแท้จริง—ข้อจำกัดด้านวาจาอาจส่งผลกระทบต่อด้านความคิดด้วย ความกังวลนี้ยังไม่ได้ถูกยุติอย่างชัดเจน แต่ก็ควรนำมาพิจารณาเมื่อประเมินผลลัพธ์ Skill good, skill go viral แม้จะมีข้อควรระวัง เทคนิคนี้ก็ได้ชีวิตที่สองบน GitHub แทบจะทันที

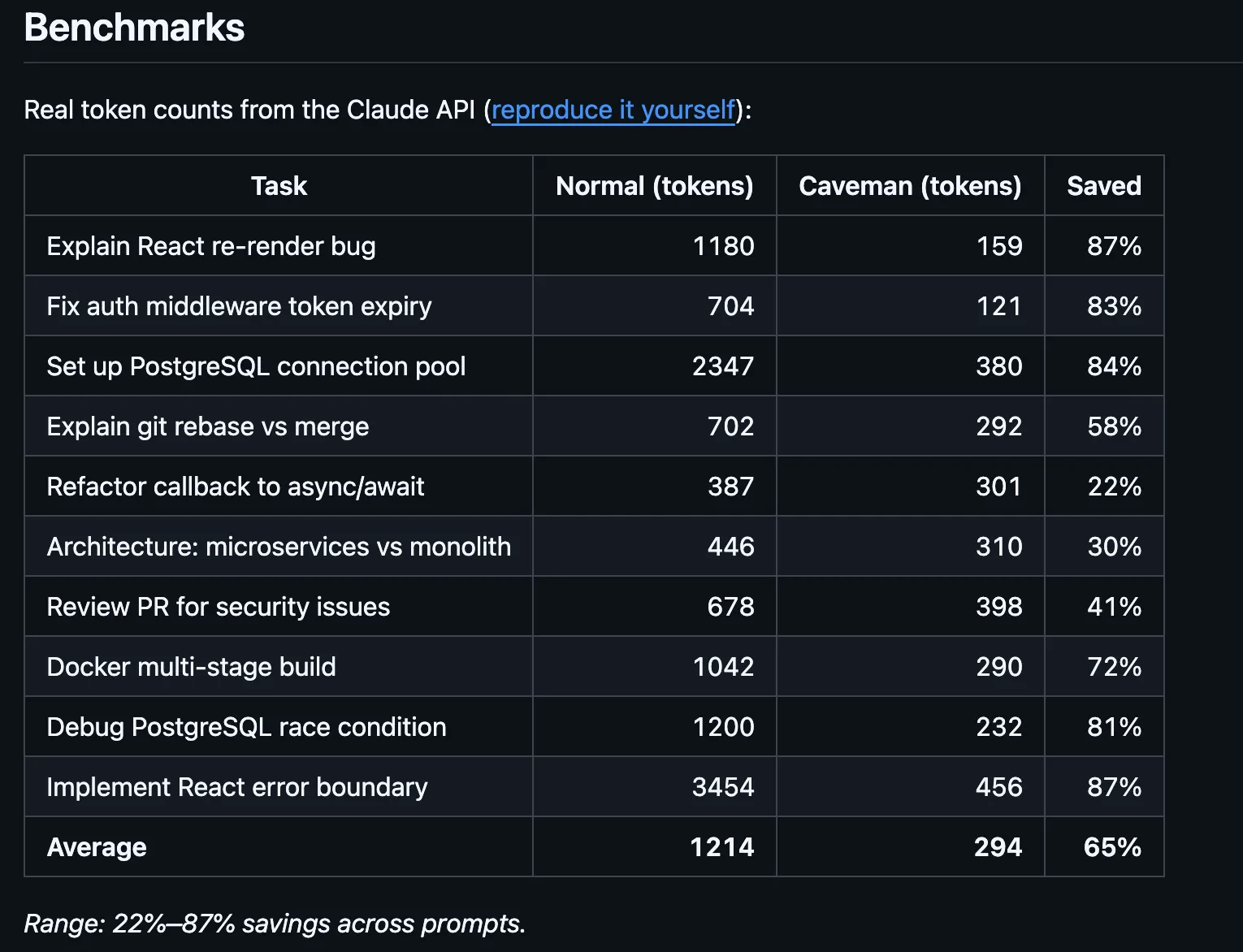

นักพัฒนา Shawnchee ได้แพ็กกฎเกณฑ์เหล่านี้เป็น caveman-skill แบบสแตนด์อโลนที่เข้ากันได้กับ Claude Code, Cursor, Windsurf, Copilot และเอเจนต์อื่นๆ อีกกว่า 40 รายการ สกิลนี้สรุปวิธีการเป็น 10 กฎ: ไม่มีวลีเติมคำ สั่งให้ทำก่อนอธิบาย ไม่มีเมตาคอมเมนต์ ไม่มีคำเกริ่น ไม่มีคำปิด ไม่มีประกาศเครื่องมือ อธิบายเมื่อจำเป็นเท่านั้น ให้โค้ดพูดแทนตัวเอง และถือว่า “ข้อผิดพลาด” เป็นสิ่งที่ต้องแก้ แทนที่จะไปเล่าเป็นเรื่องราว ผลการทดสอบ (benchmarks) ในรีโป พิสูจน์ด้วย tiktoken แสดงการลดลงของโทเคนเอาต์พุต 68% สำหรับงานค้นหาเว็บ 50% สำหรับการแก้ไขโค้ด และ 72% สำหรับการแลกเปลี่ยนแบบถาม-ตอบ—ส่งผลให้ค่าเฉลี่ยการลดเอาต์พุต 61% ใน 4 งานมาตรฐาน รีโปคู่ขนานโดยนักพัฒนา Julius Brussee ใช้วิธีที่ต่างออกไปเล็กน้อย โดยวางแนวคิดเดียวกันเป็นไฟล์ SKILL.md ที่มี 562 stars บน GitHub สเปกคือ: ตอบเหมือนมนุษย์ถ้ำที่ฉลาด ตัดบทความ คำเติม และคำทักทายสรรพไมตรีไว้ ให้คงสาระทางเทคนิคทั้งหมด บล็อกโค้ดยังคงไม่เปลี่ยนแปลง ข้อความแสดงข้อผิดพลาดถูกยกมาแบบคำต่อคำ คำศัพท์ด้านเทคนิคยังคงอยู่ Caveman พูดได้แค่ “ส่วนห่อหุ้มภาษาอังกฤษ” รอบข้อเท็จจริง

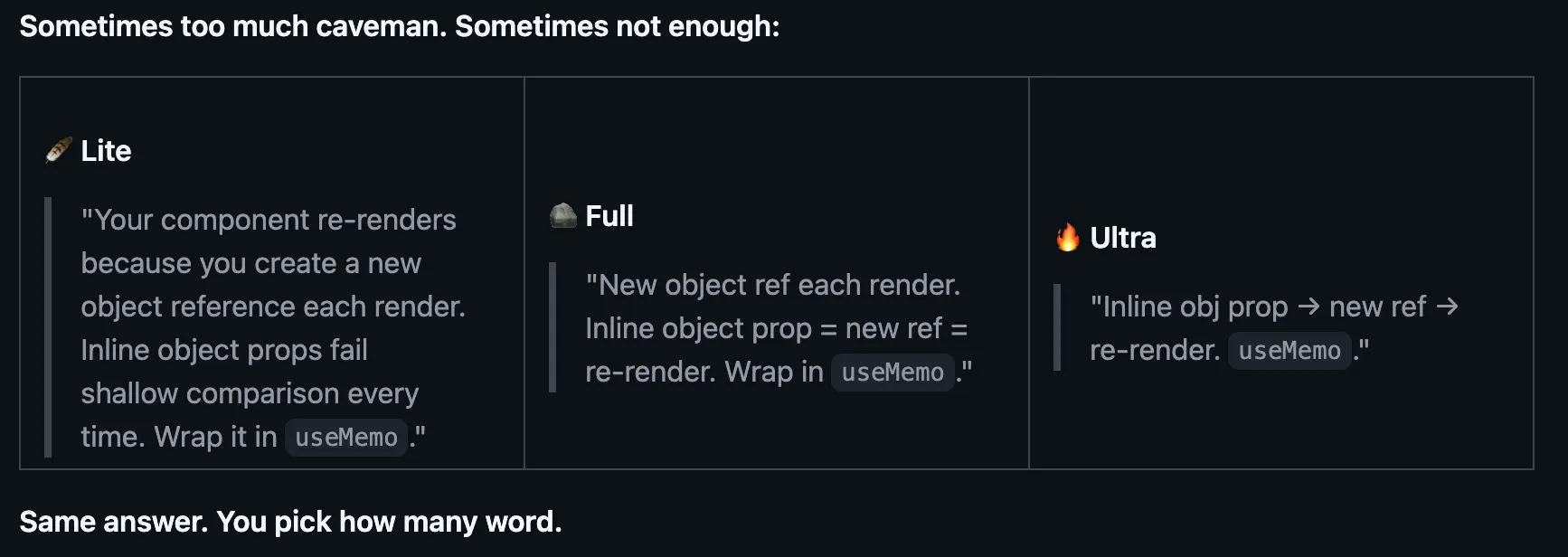

อันนี้ยังมาพร้อมกับโหมดที่แตกต่างกันเพื่อปรับว่าคุณอยากตัดทอนมากน้อยแค่ไหน สลับระหว่าง Normal, Lite และ Ultra โมเดลทำงานเดียวกันทุกอย่าง แต่ให้คำตอบที่สั้นลงมาก ซึ่งส่งผลให้ประหยัดได้มากเมื่อเวลาผ่านไป

บริบทต้นทุนที่กว้างขึ้นทำให้เรื่องตลกคมขึ้นอีกระดับ Anthropic เป็นหนึ่งในโมเดลที่แพงที่สุดเมื่อคิดตามราคาต่อโทเคน สำหรับนักพัฒนาที่รันเวิร์กโฟลว์แบบ agentic ที่มีหลายสิบเทิร์นต่อเซสชัน ความยาวของเอาต์พุตไม่ใช่แค่เรื่องสไตล์ แต่เป็นรายการค่าใช้จ่าย หากมนุษย์ถ้ำ grunt สามารถแทนที่สรุปห้าประโยคว่่าโมเดลเพิ่งทำอะไรไปได้ โทเคนที่ประหยัดได้ก็จะสะสมเพิ่มขึ้นในคำเรียก API นับพันครั้ง ทักษะมนุษย์ถ้ำติดตั้งได้ด้วยคำสั่งเดียวผ่าน skills.sh และทำงานได้ทั่วโลกข้ามโปรเจกต์ ไม่ว่าจะทำให้ Claude พูดน้อยลงเล็กน้อยหรือไม่ มันได้ทำให้นักพัฒนาจำนวนมากไม่ค่อยหงุดหงิดลงอย่างมีนัยสำคัญแล้ว