OpenAI-CEO: Menschen verschwenden mehr Ressourcen und sind weniger wertvoll als KI, anti-menschliche Äußerungen verärgern das Internet

Altman bei der indischen Konferenz den Energieverbrauch von KI-Datenzentren im Vergleich zu den 20 Jahren menschlicher Entwicklungskosten, löste Kontroversen über Anti-Menschlichkeit und Kernenergieinteressen aus.

Wenn KI-Datenzentren mit der menschlichen Entwicklungsgeschichte konkurrieren

Angesichts der zunehmenden globalen Aufmerksamkeit für den Energieverbrauch von Künstlicher Intelligenz (KI) äußerte sich OpenAI-CEO Sam Altman kürzlich auf dem AI Impact Summit in Indien mit einer schockierenden Aussage.

Anstatt auf übliche PR-Floskeln oder technische Erklärungen einzugehen, forderte Altman direkt die traditionelle Wahrnehmung der Gesellschaft heraus, die den Umweltfußabdruck großer Sprachmodelle wie ChatGPT kritisiert.

Er präsentierte eine avantgardistische und kontroverse Ansicht: Während die Öffentlichkeit die Strombelastung von Datenzentren kritisiert, werde die enormen Kosten für die Entwicklung eines Menschen übersehen. Altman argumentiert, dass „Intelligenzproduktion“ als Energieumwandlungsprozess betrachtet werden sollte. Er meint, die Gesellschaft konzentriere sich auf die kalten Serverräume, vergesse aber, dass das Aufwachsen eines Babys zu einem produktiven Individuum ebenfalls einen erstaunlichen Energieaufwand erfordere.

Diese Logik, biologisches Wachstum mit Modelltraining gleichzusetzen, verändert grundlegend die Diskussion über die Umweltauswirkungen von KI. Während OpenAI auf die Erreichung einer allgemeinen künstlichen Intelligenz (AGI) hinarbeitet, erscheinen solche Ressourcendebatten provokant und verleihen einem ursprünglich technischen Thema eine kalte Kosten-Nutzen-Bewertung. Obwohl Datenzentren viel Strom verbrauchen, argumentiert Altman, dass die daraus resultierenden Erkenntnisse und Intelligenzgewinne in einem längeren Zeitrahmen im Vergleich zu den Kosten der menschlichen Entwicklung betrachtet werden sollten.

Altman sieht biologische Ineffizienz

Laut Altman auf dem Summit braucht ein Mensch etwa 20 Jahre, um „klug“ zu werden. Während dieser langen Zeit konsumiert der Mensch große Mengen an Nahrung, Wasser, Raum und sozialen Ressourcen. Er betonte gegenüber der indischen Zeitung „The Indian Express“, dass die menschliche Entwicklung auf einer langen evolutionären Geschichte beruht, die auf dem Lernen von Hunderten Milliarden Menschen basiert, die vor Tausenden von Jahren Raubtiere vermieden und Überlebenserfahrungen gesammelt haben.

Altman schlussfolgert daraus: Wenn man die „Energieeffizienz“ für die Erreichung gleicher Intelligenz bewertet, sei KI wahrscheinlich bereits gleichauf oder sogar überlegen.

Der Vergleich zwischen biologischer Evolution und Silizium-basiertem Training offenbart die extremen Effizienzansprüche technischer Eliten. Aus Altmans Sicht, obwohl KI-Datenzentren viel Energie verbrauchen, können sie in vergleichsweise kurzer Zeit Wissen zusammenfassen und Berechnungen durchführen, während die Entwicklung des menschlichen Gehirns langwierig und variabel ist. Er deutet sogar an, dass die Effizienz von Datenzentren rapide steigt, was den Menschen in Bezug auf reine Ressourceneffizienz in den Schatten stellt. Diese Algorithmisierung des menschlichen Lebens, bei der es nur um Energieverbrauch geht, ignoriert vollständig Emotionen, Kreativität und die Unersetzlichkeit biologischer Existenz.

Für Altman ist die 20-jährige menschliche Entwicklung eine äußerst ineffiziente Art des Lernens, während KI durch intensiveren Energieeinsatz schneller wächst.

Kalte Kalkulation der Tech-Eliten? Kritik aus Industrie und Online-Community

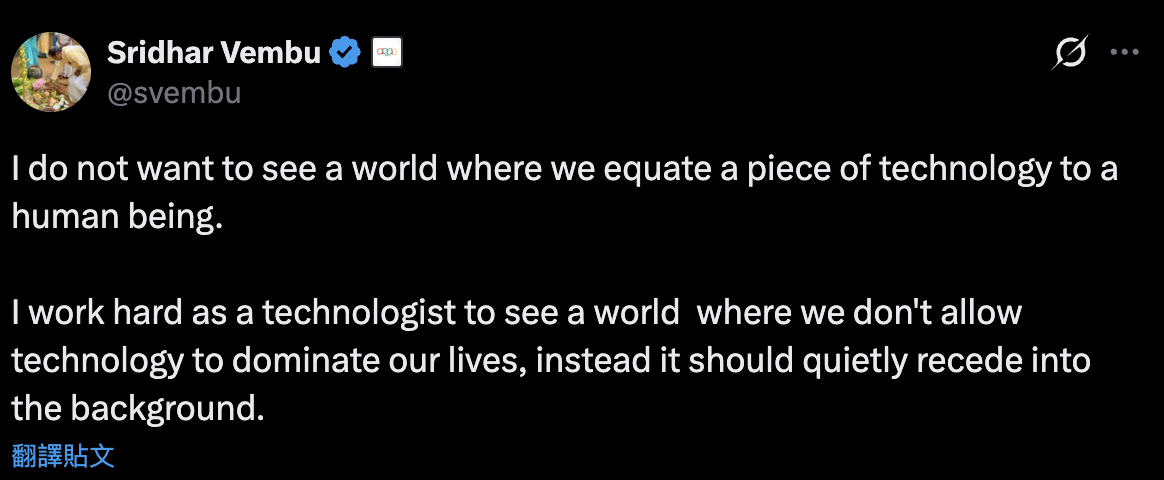

Diese Argumentation stieß schnell auf Widerstand. Sridhar Vembu, Mitgründer des indischen Software-Giganten Zoho, war vor Ort und äußerte auf X scharfe Ablehnung. Er betonte, er wolle keine Welt sehen, in der Technologie mit Menschlichkeit gleichgesetzt wird.

Vembu vertritt die Ansicht, dass Technik im Leben eine ruhige, unterstützende Rolle spielen sollte, die den Menschen dient, anstatt ihn zu dominieren oder zu ersetzen. Er äußerte Bedenken gegenüber der Tendenz, Technologie und Leben zu vermengen, was seiner Meinung nach die kollektive Blindheit der Silicon-Valley-Führung gegenüber menschlicher Wärme widerspiegelt.

Bildquelle: X/@svembu Mitgründer des indischen Software-Giganten Zoho Sridhar Vembu ist äußerst ablehnend gegenüber Altmans Ansichten und betont, er wolle keine Welt, in der Technologie mit Menschlichkeit gleichgesetzt wird.

Vembus Haltung spiegelt die Sicht vieler traditioneller Technikexperten wider: Technik soll den Menschen dienen, nicht ihn als kalkulierbare Kosten ansehen.

Die Reaktionen in den sozialen Medien sind noch direkter und empörter. Auf Reddit gibt es zahlreiche kritische Beiträge zu Altman, die seine Aussagen als „anti-menschlich“ und sogar „böse und krankhaft“ bezeichnen. Viele Kommentatoren meinen, Altman verstehe den Wert menschlichen Lebens jenseits von Kostenanalysen für Code und Systeme nicht.

Der Tech-Analyst Max Weinback warnte ebenfalls: Wenn Menschen auf ihre „Produktionskosten“ reduziert werden und die Menschlichkeit ignoriert wird, führt das zu negativen gesellschaftlichen Entwicklungen. Diese Logik, Menschen als „ressourcenverschwendende Last“ zu sehen, berührt die Würde des Menschen und gefährdet das Markenimage von OpenAI, das unter dem Etikett der Effizienz steht.

Kernenergie-Strategie und Endzeit-Prognosen: Interessen zwischen AGI und grüner Energie

Inmitten der Kontroversen schlug Altman eine scheinbar energielindernde Lösung vor: Die Welt müsse rasch auf Kernenergie, Wind- und Solarenergie umsteigen. Doch hinter diesem Vorschlag verbergen sich komplexe Interessenskonflikte. Altman ist auch Vorsitzender des Nuklear-Startups Oklo, was bei Kritikern den Eindruck erweckt, seine Energiepolitik sei von persönlichen Geschäftsinteressen beeinflusst. Kritiker bezweifeln, dass er die Angst vor KI-Energieverbrauch schürt, um gleichzeitig Investitionen in eigene Energieprojekte zu fördern. Diese Mischung aus Geschäftsinteressen und moralischer Rhetorik wirft Zweifel an seinen Motiven auf.

Altmans frühere Aussagen zeigen eine widersprüchliche Haltung:

- Er prognostizierte öffentlich, dass KI die Welt zerstören könnte, förderte aber gleichzeitig die Entwicklung großer Unternehmen auf dieser Basis;

- Er sagte im Kongress, KI könne für biologische Waffen genutzt werden, verfolgt aber weiterhin die Durchbrüche bei AGI;

- Seine Rhetorik, die vor existenziellen Risiken warnt, während er Menschen mit Datenmüll gleichsetzt, spiegelt die psychologische Verfassung der heutigen Tech-Führung wider.

Wenn der Energiebedarf von KI weiter steigt, ist das Spektrum an Ressourcen-, Effizienz- und Humanitätskonflikten möglicherweise erst am Anfang. Wie die Menschheit in der von Silicon Valley definierten „Effizienz“ und ihrem eigenen Wert eine Balance finden wird, bleibt die zentrale Herausforderung dieser technologischen Revolution.

Verwandte Artikel

Wenn ich selbst nicht beweisen kann, dass ich kein KI bin, empfehlen Forensik-Experten: Vereinbaren Sie mit Familie und Freunden ein geheim Codewort.

Macquarie: Die Lage zwischen den USA und Iran könnte in eine "dritte Phase von Verhandlungen und Kämpfen" eintreten, militärische Operationen könnten bis Mitte April andauern

Trump signalisiert gegenüber seinen Mitarbeitern, dass er den Krieg im Iran in den kommenden Wochen beenden möchte.

Polymarket "Clarity Act wird 2026 zum Gesetz unterzeichnet" Wahrscheinlichkeit 54%, 24-Stunden-Rückgang 11%

Google Quantenbedrohungswarnung: 2029 als Stichtag für Post-Quantenkryptographie